En analys från Epoch AI ifrågasätter ett vanligt påstående om ChatGPT:s energiförbrukning. Enligt det gamla estimatet från 2023 förbrukar en ChatGPT-fråga 3 wattimmar. Epoch AI:s nya beräkning landar på 0,3 wattimmar – tio gånger lägre. För projektledare som rapporterar AI:s klimatpåverkan är skillnaden betydande.

ChatGPT:s energiförbrukning – huvudpunkter

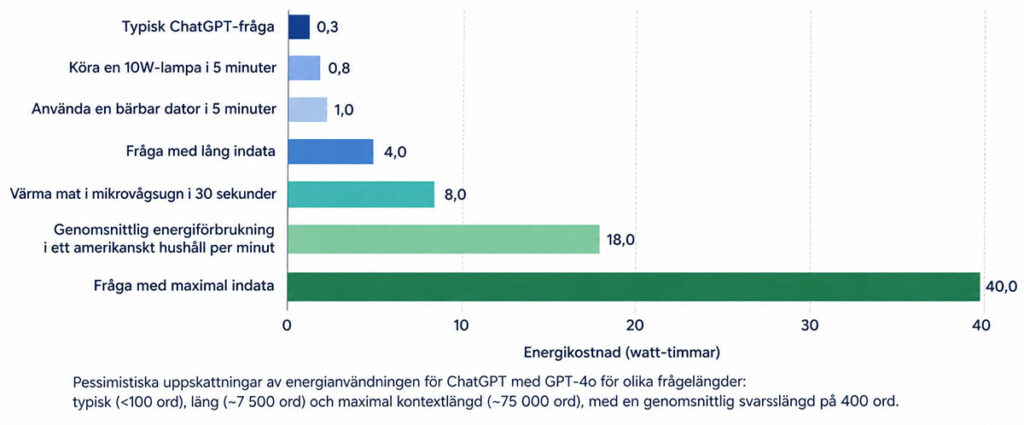

- En typisk GPT-4o-fråga med 500 output-tokens förbrukar cirka 0,3 wattimmar. Det gamla estimatet på 3 wattimmar kom från Alex de Vries (2023) och byggde på äldre hårdvara och högre tokenantal (källa: Epoch AI, 2025-02-07).

- Det gamla estimatet antog 2 000 output-tokens per fråga. Epoch AI använder 500 tokens. Det är mer representativt – ett stort dataset visade ett snitt på 269 tokens per svar (källa: Epoch AI, 2025-02-07).

- Långa input-texter kostar mer energi. En fråga med 10 000 input-tokens kostar ungefär 2,5 wattimmar. Med 100 000 input-tokens stiger kostnaden till nära 40 wattimmar (källa: Epoch AI, 2025-02-07).

- Ingångskostnaden för uppladdade filer är en engångskostnad. Den upprepas inte vid varje nytt meddelande i samma konversation (källa: Epoch AI, 2025-02-07).

- Reasoning-modeller som o1 och o3-mini genererar ungefär 2,5 gånger fler tokens än GPT-4o. Det ökar deras energiförbrukning proportionellt (källa: Epoch AI, 2025-02-07).

- Beräkningsutnyttjandet vid inferens är cirka 10 procent av GPU:ns maxkapacitet. Det innebär att tio gånger fler GPU:er krävs än om maxkapaciteten uppnåddes (källa: Epoch AI, 2025-02-07).

- ChatGPT-användare skickar 1 miljard meddelanden per dag. Med 0,3 wattimmar per fråga kräver det ungefär 12,5 megawatt kontinuerlig effekt (källa: Epoch AI, 2025-02-07).

Vad detta betyder för projektledare

- Modellval påverkar energikostnaden direkt. GPT-4o-mini, GPT-4o och reasoning-modeller som o1 skiljer sig stort i energiåtgång. Specificera vilken modell som används och för vilka uppgifter.

- Långa dokument är dyra att processa. En fil med 100 000 tokens kan kosta upp till 40 wattimmar per fråga. Det är 130 gånger mer än en standardfråga. Ta med det i hållbarhetskalkylen.

- Gamla siffror kan vara tio gånger för höga. Estimatet på 3 wattimmar bygger på antaganden från 2023. Använd Epoch AI:s uppdaterade siffra som referens i rapporter och beslutsunderlag.

- AI-leverantörer saknar transparens. Epoch AI konstaterar att bättre data kräver tillgång till faktiska driftsiffror. OpenAI offentliggör inte dessa. Ställ transparenskrav i leverantörsavtal.

Begrepp i artikeln

- Inferens: Att köra en färdigtränad AI-modell för att generera svar. Det sker vid varje ChatGPT-fråga.

- Token: Grundläggande textenhet i språkmodeller. En token motsvarar i genomsnitt 0,75 ord för OpenAI.

- Beräkningsutnyttjande: Andel av GPU:ns maxkapacitet som faktiskt används. Vid inferens är det cirka 10 procent.

- Mixture-of-experts (MoE): Modellarkitektur där bara en del av parametrarna aktiveras per fråga. Det minskar energiåtgången.

- KV-cache: Teknisk optimering som sparar mellanresultat från input-tokens. Det minskar beräkningskostnaden i långa konversationer.

Vanliga frågor

Hur mycket energi förbrukar en ChatGPT-fråga enligt Epoch AI? Epoch AI estimerar att en typisk GPT-4o-fråga med 500 output-tokens förbrukar cirka 0,3 wattimmar — tio gånger lägre än det tidigare ofta citerade estimatet på 3 wattimmar. Estimatet är avsiktligt pessimistiskt och kan vara lägre för korta frågor (källa: Epoch AI, 2025-02-07).

Varför är det gamla estimatet på 3 wattimmar för högt? Det ursprungliga estimatet från 2023 antog 2 000 output-tokens per fråga och byggde på äldre hårdvara (A100 GPU) och en äldre modell med fler aktiva parametrar. Epoch AI använder nyare hårdvara (H100), en mer effektiv modell (GPT-4o) och ett mer representativt tokenantal (källa: Epoch AI, 2025-02-07).

Förbrukar reasoning-modeller mer energi? Ja. Reasoning-modeller som o1 och o3-mini genererar i genomsnitt ungefär 2,5 gånger fler tokens än GPT-4o per fråga, vilket ökar energiförbrukningen proportionellt. Exakt energiåtgång beror på frågans komplexitet och hur lång resoneringskedjan är (källa: Epoch AI, 2025-02-07).

Hur påverkar långa dokument energiförbrukningen? Att ladda upp ett dokument med 10 000 tokens ökar energiförbrukningen per fråga till ungefär 2,5 wattimmar. Ett dokument med 100 000 tokens kan kosta nära 40 wattimmar — men detta är en engångskostnad per uppladdning, inte per meddelande i konversationen (källa: Epoch AI, 2025-02-07).

Källa: How much energy does ChatGPT use? / Epoch AI, Josh You, publicerad 2025-02-07.

Läs även

- Sökmotorer vs AI – energiförbrukning och koldioxidutsläpp jämfört

- Koldioxidavtrycket från träning av GPT-4 – uppskattningar och energiförbrukning

- AI Energy Score Leaderboard – energieffektivitet hos AI-modeller